11月5日消息,騰訊今日宣布推出業界參數規模最大、效果最好的開源MoE大語言模型Hunyuan-Large。

Huanyuan-large模型的總參數量為389B、激活參數為52B、訓練token數量為7T、最大上下文長度為256K、詞表大小為12.8w。

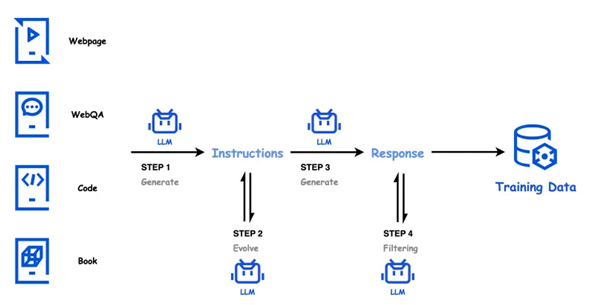

在技術創新方面,Hunyuan-large通過高質量的合成數據來增強模型訓練,彌補了自然數據的不足。

其中,該模型預訓練支持處理高達256K的文本序列,大幅提升了長文本上下文的處理能力,能夠更高效地完成長文本任務。

據了解,Hunyuan-large在CMMLU、MMLU、CEva1、MATH等多學科綜合評測集上表現優異,在中英文自然語言處理、代碼生成、數學運算等9大能力維度中全面領先,超越了Llama3.1和Mixtral等一流開源模型。

此外,騰訊還宣布將推出自研的長文評測集“企鵝卷軸(PenguinScrolls)”,以填補行業在真實長文評測集上的空白。

企鵝卷軸基于公開的金融、法律、學術論文等長文本構建,文本長度從1K到128K不等,覆蓋深度閱讀理解和長文推理任務。

本站內容除特別聲明的原創文章之外,轉載內容只為傳遞更多信息,并不代表本網站贊同其觀點。轉載的所有的文章、圖片、音/視頻文件等資料的版權歸版權所有權人所有。本站采用的非本站原創文章及圖片等內容無法一一聯系確認版權者。如涉及作品內容、版權和其它問題,請及時通過電子郵件或電話通知我們,以便迅速采取適當措施,避免給雙方造成不必要的經濟損失。聯系電話:010-82306118;郵箱:[email protected]。